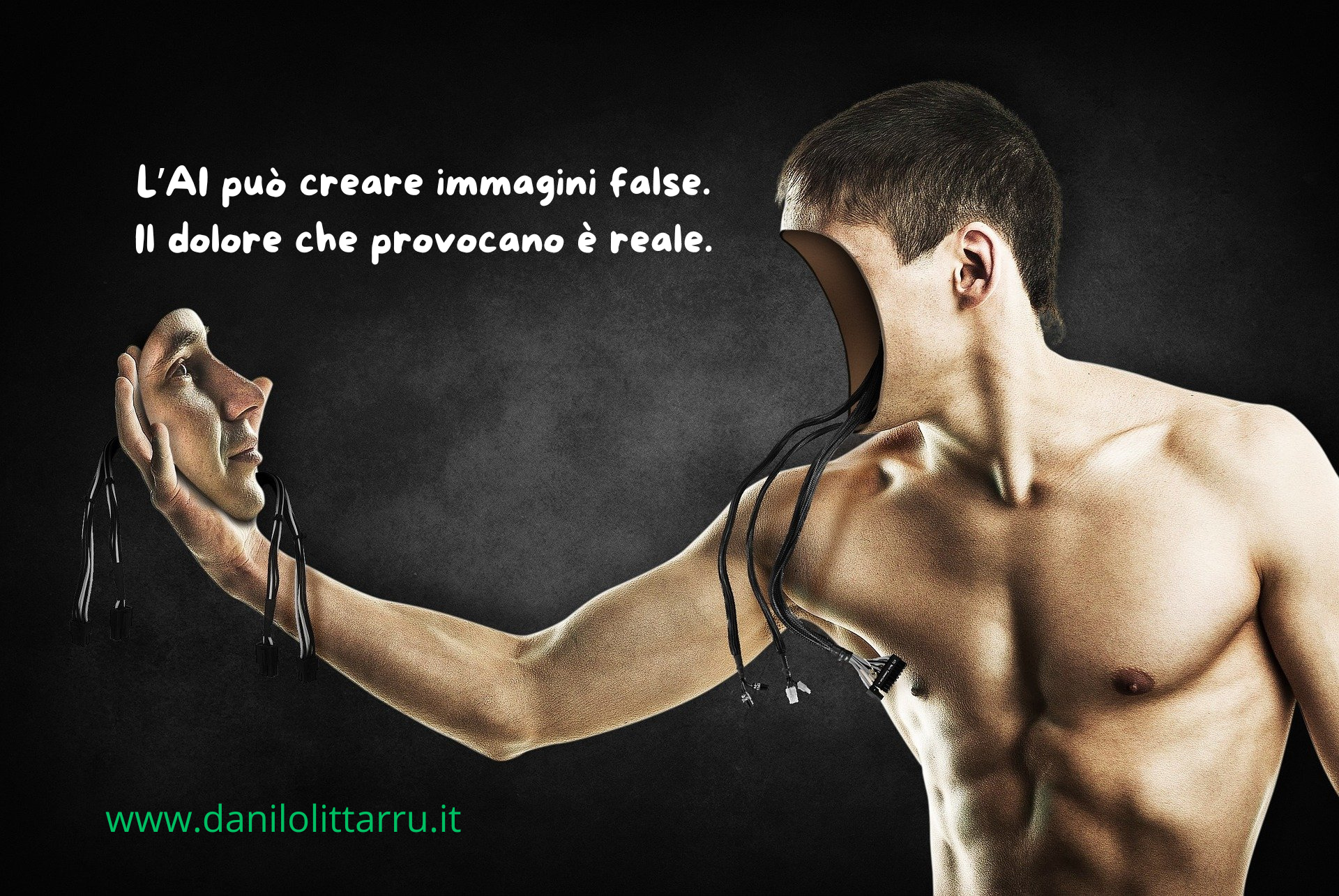

Quando l’Intelligenza Artificiale diventa violenza invisibile..

Non è più necessario spogliare fisicamente una persona per violarne l’intimità.

Oggi basta una fotografia innocente, caricata su una piattaforma alimentata dall’Intelligenza Artificiale, per generare immagini sessualmente esplicite false ma estremamente realistiche. È il fenomeno del deepnude, una delle derive più inquietanti dell’AI generativa e, probabilmente, la nuova frontiera del cyberbullismo contemporaneo.

Dietro l’apparente leggerezza di una “modifica digitale” si nasconde un meccanismo psicologico devastante: umiliazione pubblica, perdita di controllo della propria immagine, diffusione virale, vergogna sociale, isolamento, ansia e talvolta ideazione suicidaria.

La vittima viene esposta a una nudità mai scelta, costruita artificialmente ma percepita dagli altri come reale.

Il punto cruciale è questo: il cervello umano reagisce emotivamente all’immagine, non alla sua autenticità tecnica.

Il primo caso che ha sconvolto l’opinione pubblica

Uno dei casi che ha fatto esplodere il dibattito internazionale riguarda un gruppo di adolescenti statunitensi coinvolti nella creazione e diffusione di immagini fake di compagne di scuola attraverso applicazioni AI capaci di “spogliare” fotografie normali.

Tra i casi più discussi vi è quello emerso nel 2023 in Westfield, dove alcuni studenti liceali hanno utilizzato strumenti di nudificazione artificiale per produrre immagini sessualizzate di coetanee minorenni. La vicenda ha provocato indagini federali, interventi scolastici e un acceso dibattito giuridico sulla difficoltà di normare contenuti creati dall’AI.

Ma il fenomeno non nasce lì.

Già nel 2019 l’applicazione “DeepNude” aveva scioccato il web: un software capace di generare falsi nudi femminili tramite reti neurali. Il progetto venne ufficialmente ritirato dopo poche ore per le enormi polemiche etiche, ma il codice iniziò rapidamente a diffondersi clandestinamente online, aprendo il mercato sommerso delle cosiddette nudification AI.

Oggi queste applicazioni sono più sofisticate, più accessibili e spesso utilizzate direttamente dagli adolescenti.

Perché il deepnude è diverso dal cyberbullismo tradizionale

Il cyberbullismo classico agiva soprattutto attraverso:

- insulti,

- esclusione sociale,

- derisione,

- diffusione di immagini reali.

Il deepnude introduce invece un elemento nuovo e drammatico: la produzione artificiale della violenza.

La vittima non deve nemmeno aver inviato foto intime.

L’aggressore può crearle dal nulla.

Questo cambia completamente il paradigma educativo e giuridico.

L’effetto psicologico: il trauma dell’immagine alterata

Dal punto di vista clinico, il deepnude produce effetti assimilabili alle esperienze di violazione dell’identità corporea.

Molte vittime riferiscono:

- sensazione di contaminazione;

- perdita del controllo della propria immagine;

- paura dello sguardo altrui;

- evitamento scolastico;

- sintomi ansiosi;

- ipervigilanza digitale;

- ritiro sociale.

Negli adolescenti il danno è ancora più profondo perché il corpo rappresenta il nucleo fragile della costruzione identitaria.

La psicologia dello sviluppo mostra infatti come, durante l’adolescenza, il giudizio dei pari abbia un peso neuroemotivo enorme. Le aree cerebrali legate alla ricompensa sociale e alla vergogna risultano particolarmente sensibili in questa fase evolutiva.

Il problema educativo: adulti tecnologicamente in ritardo

Molti genitori e docenti non conoscono nemmeno l’esistenza di queste applicazioni.

Ed è qui che il fenomeno cresce nel silenzio.

La velocità dell’AI supera la capacità educativa degli adulti.

La scuola spesso interviene quando il danno è già virale.

Il problema non è soltanto tecnologico.

È culturale.

Una generazione sta imparando che tutto può essere manipolato, modificato, simulato. Anche il corpo umano diventa un oggetto digitale da alterare per ottenere consenso, risate, vendetta o potere sociale.

L’illusione dell’anonimato

Molti adolescenti credono che utilizzare piattaforme anonime o gruppi chiusi li renda invisibili.

Non è così.

Le indagini di polizia postale mostrano che:

- screenshot,

- metadati,

- cronologia cloud,

- IP,

- cronologie di condivisione

consentono spesso di risalire agli autori.

In Italia, la diffusione di immagini sessualmente esplicite — anche se artificiali — può intrecciarsi con:

- diffamazione,

- trattamento illecito di dati,

- sostituzione di persona,

- pornografia minorile,

- revenge porn,

- atti persecutori.

Quando coinvolge minori, il quadro giuridico diventa estremamente delicato.

L’AI non è il nemico: il problema è l’uso

L’Intelligenza Artificiale rappresenta una rivoluzione straordinaria:

- medicina,

- didattica,

- accessibilità,

- ricerca scientifica,

- riabilitazione.

Ma ogni tecnologia amplifica anche l’intenzione umana.

L’AI può educare oppure distruggere.

Può generare conoscenza oppure umiliazione.

La vera emergenza educativa dei prossimi anni non sarà imparare a usare l’AI, ma imparare a sviluppare coscienza morale nell’uso dell’AI.

Perché una società tecnologicamente avanzata ma emotivamente immatura rischia di trasformare l’innovazione in una nuova forma di violenza invisibile.

Tre segnali da non sottovalutare nei ragazzi

- improvviso rifiuto della scuola;

- paura ossessiva del telefono;

- chiusura sociale dopo episodi online.

Dietro questi segnali potrebbe nascondersi molto più di una semplice “presa in giro”.